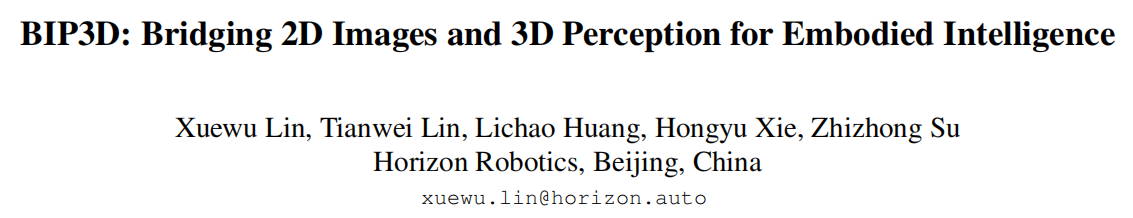

CVPR 2025|BIP3D: 连接图像和3D空间,提升具身智能的空间感知能力

2025/03/12

• 项目主页:

https://linxuewu.github.io/BIP3D-page/

• 论文地址:

https://arxiv.org/abs/2411.14869

概述

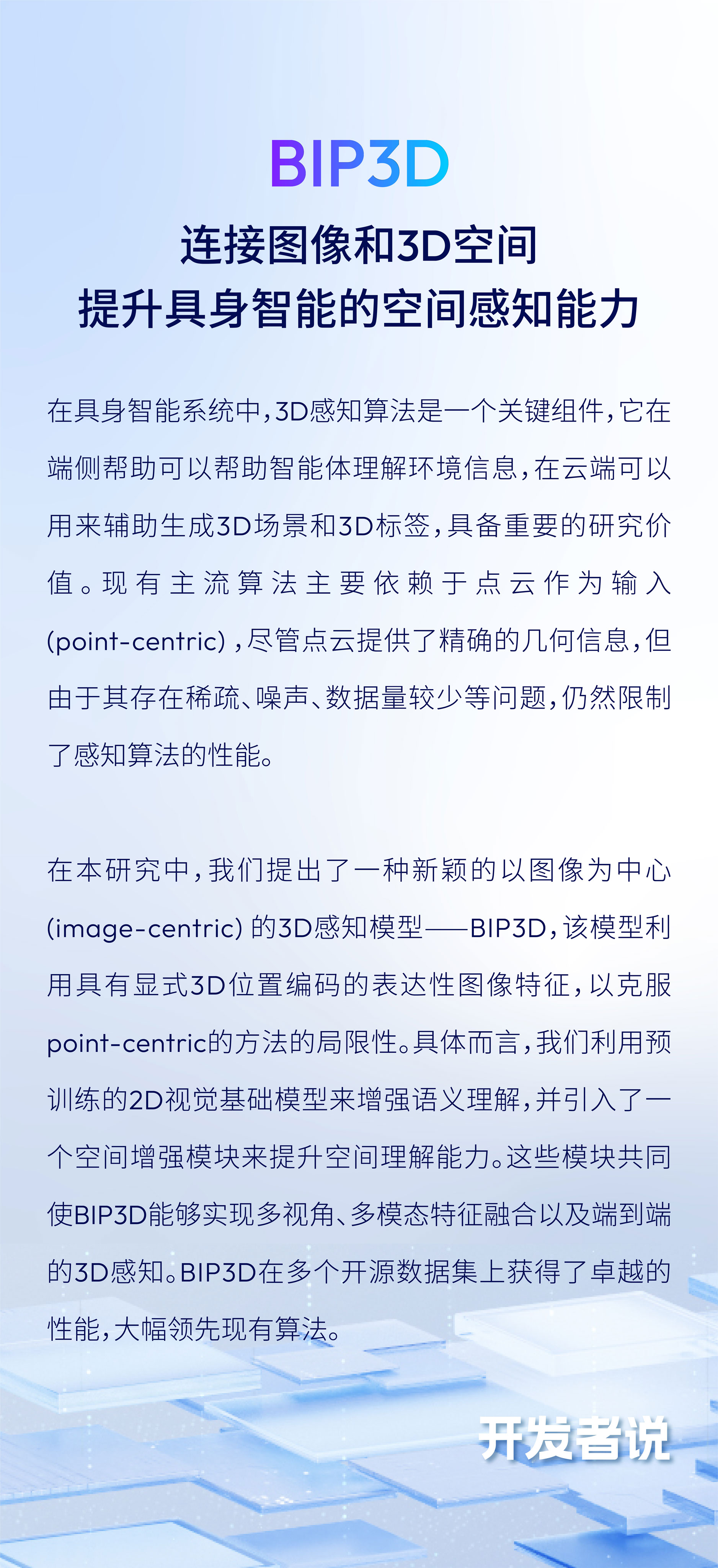

在具身智能系统中,3D感知算法是一个关键组件,它在端侧帮助可以帮助智能体理解环境信息,在云端可以用来辅助生成3D场景和3D标签,具备重要的研究价值。现有主流算法主要依赖于点云作为输入 (point-centric) ,尽管点云提供了精确的几何信息,但由于其存在稀疏、噪声、数据量较少等问题,仍然限制了感知算法的性能。

在本研究中,我们提出了一种新颖的以图像为中心 (image-centric) 的3D感知模型——BIP3D,该模型利用具有显式3D位置编码的表达性图像特征,以克服point-centric的方法的局限性。具体而言,我们利用预训练的2D视觉基础模型来增强语义理解,并引入了一个空间增强模块来提升空间理解能力。这些模块共同使BIP3D能够实现多视角、多模态特征融合以及端到端的3D感知。BIP3D在多个开源数据集上获得了卓越的性能,大幅领先现有算法。

BIP3D架构:基于Vision Foundation Model的多模态感知模型

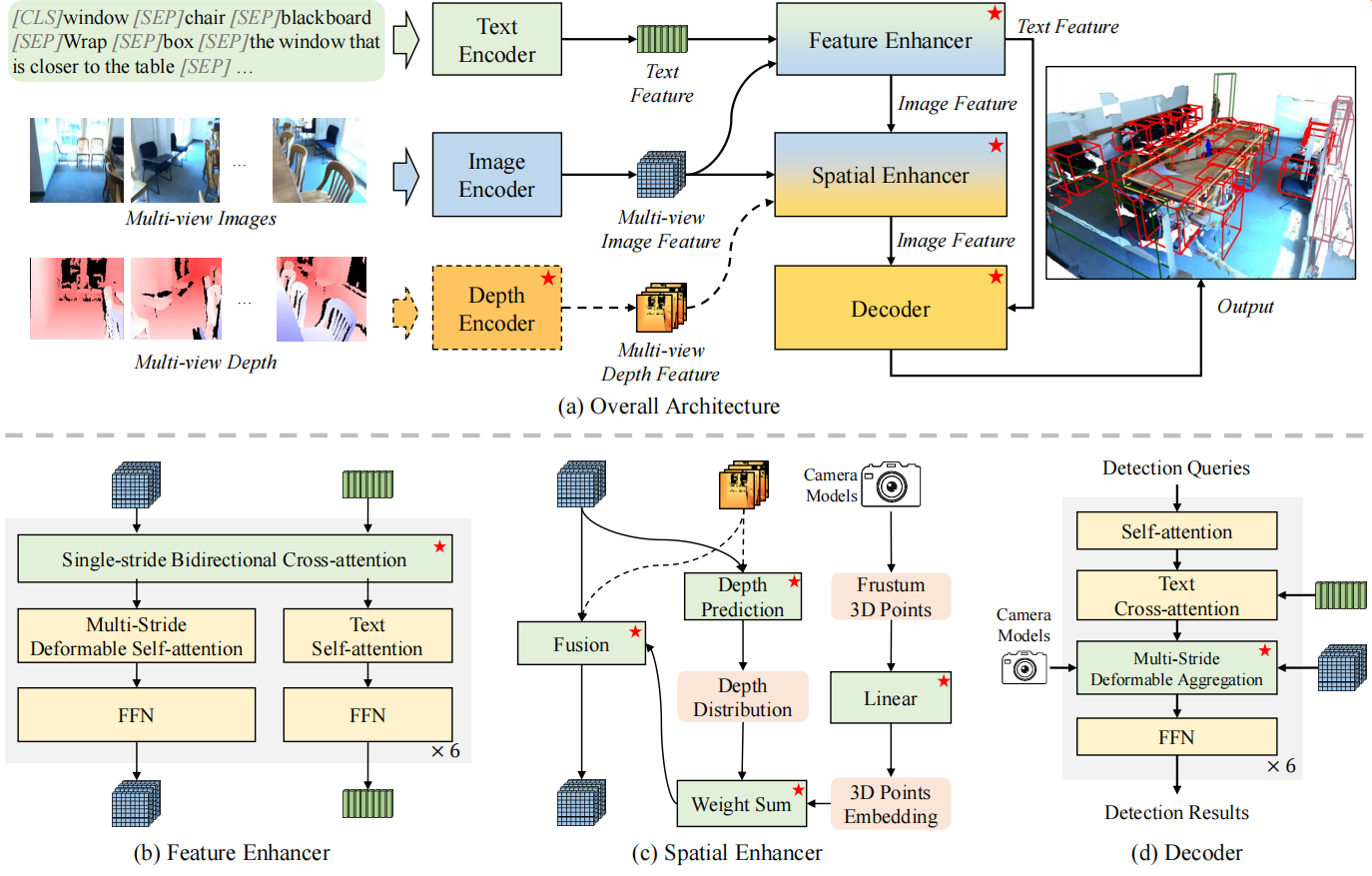

图1 BIP3D模型架构图

模型结构上,BIP3D主要包括6个模块(图1 (a) 所示):

1)text encoder:用于编码文本特征,当采用decoder-only VLM作为基座时,则用text tokenizer代替;

2)image encoder:用于编码多视角图像,输出多视角多尺度图像特征;

3)depth encoder:用于编码多视角深度图像,输出深度特征图,和图像特征保持pixel对齐,BIP3D支持纯RGB输入,因此depth encoder为可插拔模块;

4)feature enhancer:用于融合图像特征和文本特征;

5)spatial enhancer:利用相机模型对图像特征加上3D位置编码,同时融合深度特征;

6)decoder:基于spatial enhancer输出的3D特征和文本特征,结合任务目标进行解码;本文主要研究3D感知任务,因此采用了基于deformable aggregation的多视角特征融合算子来实现3D detection和grounding任务。

BIP3D的结构设计使其可以无缝衔接现有vision foundation model,本文采用Grounding-DINO作为基座来初始化BIP3D,以此获得更好的泛化性、更快的收敛速度以及更高的感知精度。除了Grounding-DINO以外,也可以采用VLM类模型(如Qwen-VL)作为基座。

Spatial Enhancer:相机建模、3D编码与深度特征融合

连接2D图像和3D空间最重要的一步就是相机建模,我们首先利用图像特征进行深度分布估计,得到一系列带深度的视点及其概率,将这些视点通过相机模型投影到统一的3D空间,并对投影后的3D坐标进行高维映射,拿到3D point embedding,并将这些3D point embedding联合所预测的概率分布进行加权求和,作为最终的3D position embedding。当模型接收深度图作为输入之一时,我们还会再深度估计时引入深度特征,以获得更精确的深度分布,并在最终输出的时候将深度特征和图像特征进行融合,作为decoder的输入。

我们的3D位置编码可以提供很好的几何信息,其特征空间的余弦距离和3D空间的欧氏距离具有显著的正相关性,如下图所示。

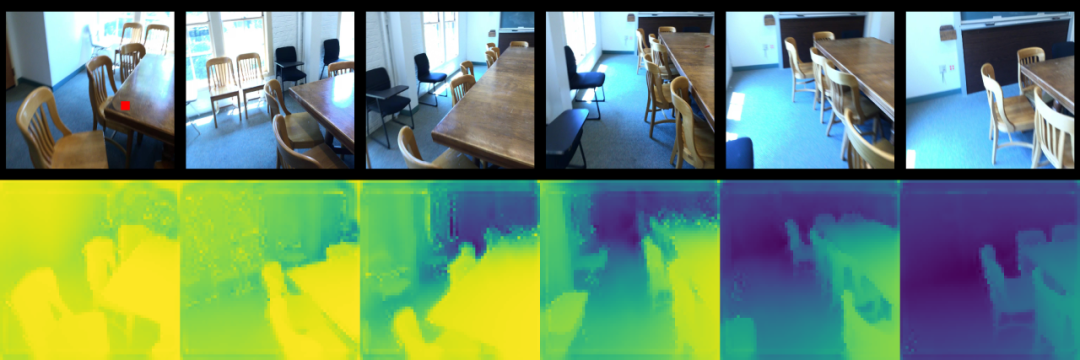

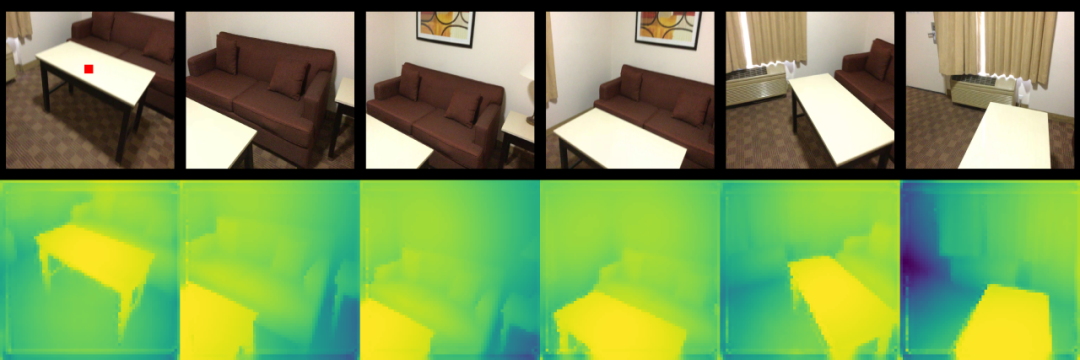

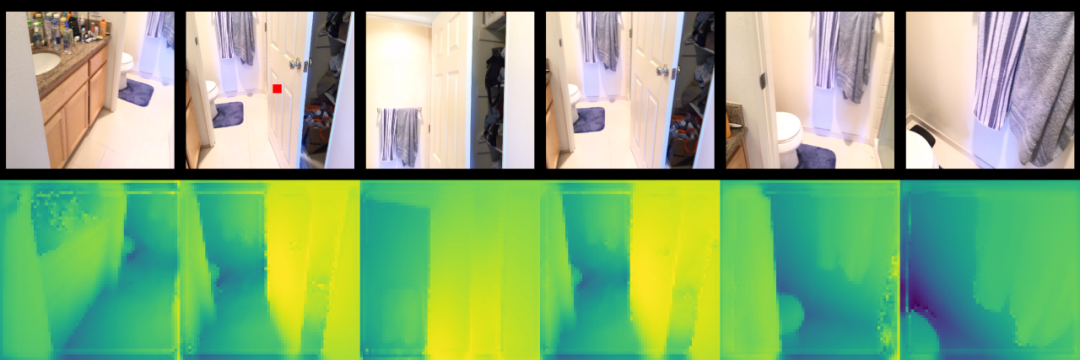

图2 3D position embedding 可视化

3D Perception Decoder:多视图融合和文本特征融合

我们采用query-based detector的结构,如图1 (d) 所示。首先生成一系列视角相关的bbox3d queries,并使用Deformable Aggregation算子实现任意视角数据的特征融合;为了实现open-set detection和grounding,还加入了text cross-attention。该decoder输出9 DoF的3d bounding bbox及其高维特征,高维特征和文本特征的余弦距离用来表示置信度。考虑到9 DoF存在方向和尺寸歧义性,我们采用Wasserstein distance作为bbox3d的回归损失函数。其次我们还加入了文本特征和query之间的对比损失,采用余弦距离和focal loss。具体实现见论文和代码。

实验结果

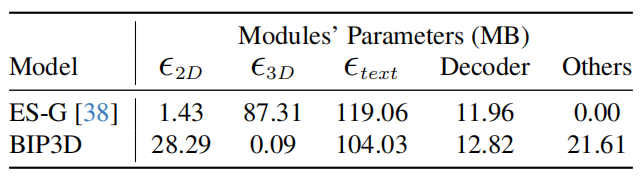

表1对比于BIP3D和point-centric方法的参数量分布情况,可以看出point-centric方法的主要参数量集中在3D encoder,而BIP3D集中在2D encoder,这是point-centric和image-centric的主要区别之一。

表1 参数量分布对比

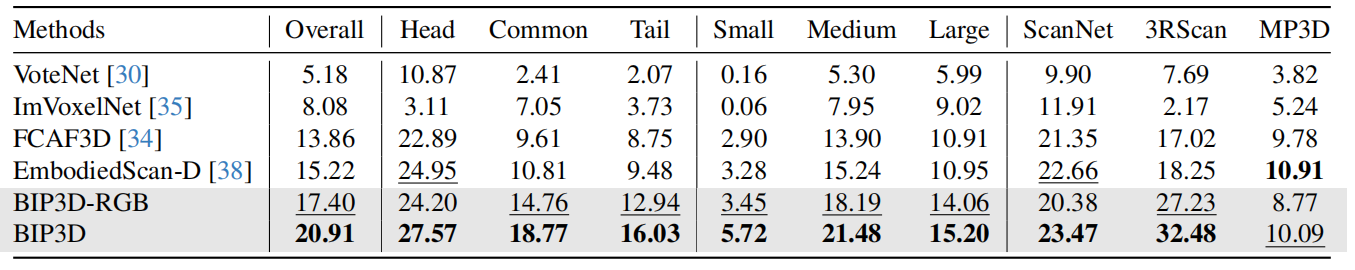

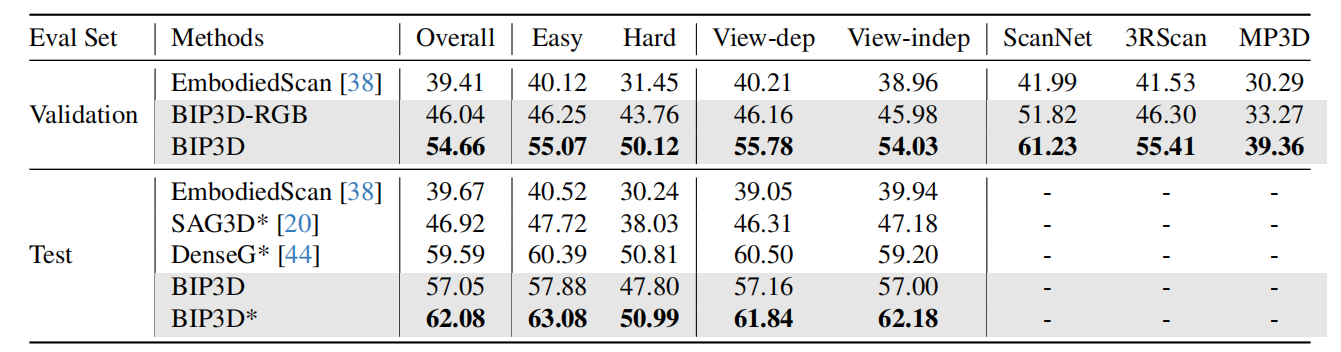

BIP3D在3D检测和3D grounding上的性能显著超越了现有方法,各项指标上都超过了EmbodiedScan的baseline。并且,当仅输入图像时,在没有深度图加持的情况下,BIP3D依然能获得不错的感知能力。

表2 3D检测结果对比

表3 3D Grounding结果对比

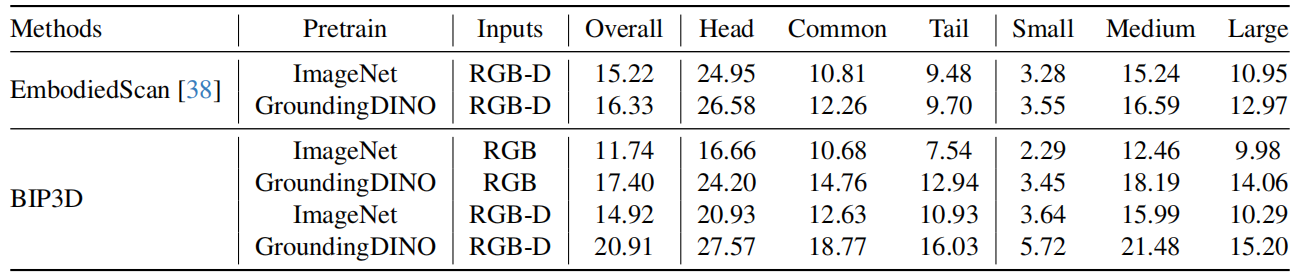

我们还证明了,BIP3D这种image-centric的网络架构可以很好的发挥出vision foundation model的作用,如表4所示。

表4 VFM的作用

更多的实验结果可见huggingface主页和论文。

总结与展望

在本研究中,我们提出了一种以图像为中心的3D感知模型——BIP3D。该模型克服了点云数据的局限性,并充分利用了2D基础模型的能力,从而在3D感知性能上实现了显著提升。BIP3D支持多视角图像、深度图和文本作为输入,使其能够执行3D目标检测和3D视觉定位任务。我们在EmbodiedScan基准测试中展示了BIP3D的优越性。然而,BIP3D仍有广阔的探索空间,以下是未来工作的几个方向:(1) 进一步优化网络架构和训练方案,以实现更卓越的感知性能。(2) 将BIP3D应用于动态场景,实现联合检测与跟踪。(3) 引入更多感知任务,如实例分割、占据空间估计和抓取姿态估计。(4) 在BIP3D网络框架下,改进decoder以支持更高级的任务,如action和3d reasoning。

分享文章

欢迎订阅地平线相关资讯,您可以随时取消订阅。

感谢您的订阅, 我们会第一时间推送地平线最新活动与资讯到您邮箱